Abstract

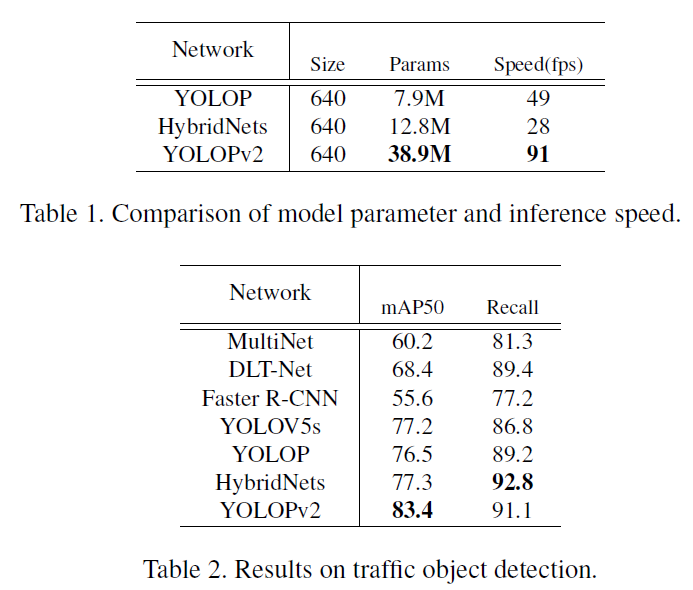

- 0.83 MAP for object detection

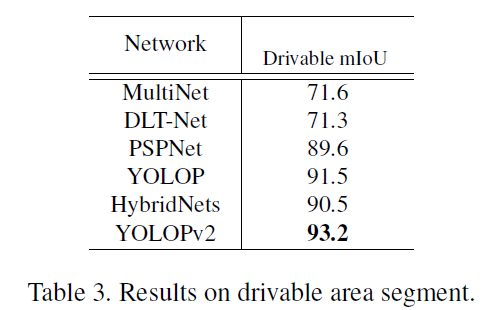

- 0.93 MIOU for the drivable area segmentation

- 87.3 accuracy for lane detection

- 91 FPS on NVIDIA TESLA V100

기존 모델과의 차이점

- 데이터 전처리: Mosaic and Mixup 적용

- Bag of Freebies (BoF) methods(?) to improve the object detection performance

계보

- UNet -> PSPNet: drivable area segmentation

- SCNN은 각 계층의 채널 간 정보 전송을 위해 슬라이스별 컨볼루션을 제안. Enet-SAD는 상위 수준 특성에서 하위 수준 특성을 학습할 수 있는 self-attention 정류 방법을 사용하므로 성능을 향상시킬 뿐만 아니라 모델의 경량 설계를 유지

--> lane detection

- YOLOP는 encoder 하나와 3개의 Head를 사용하였다. HyBridNet과 Bifpn은 이를 개선하였다 --> Multi Task Learning

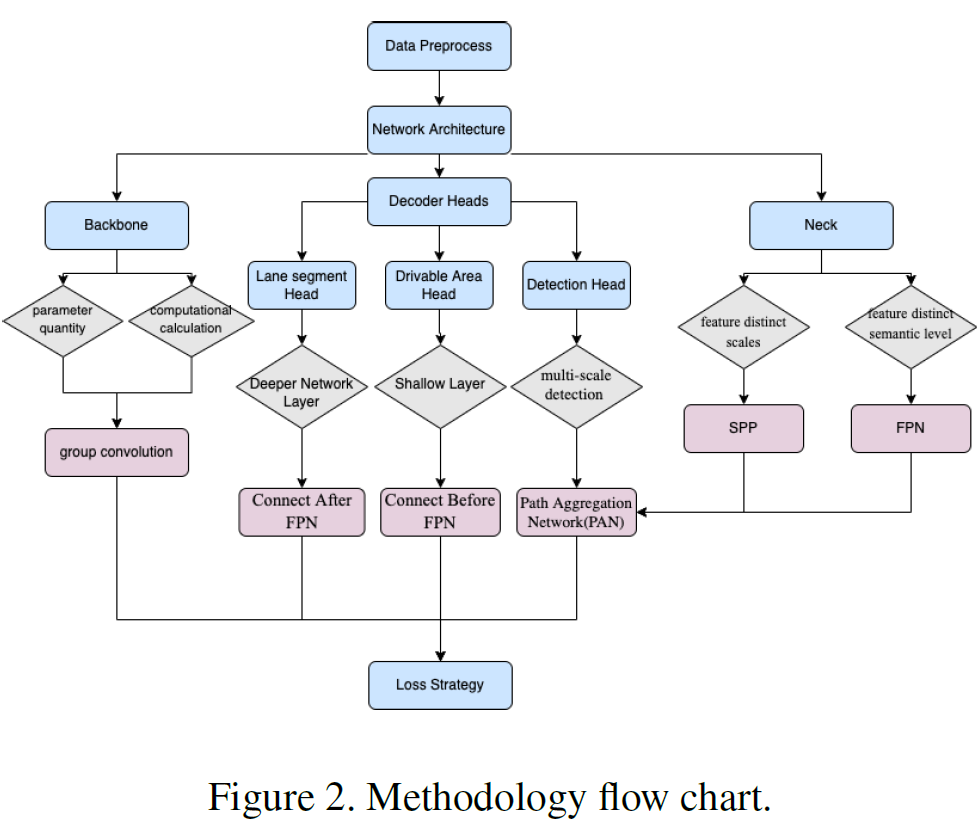

방법

- 우리 모델은 YOLOP 및 HybridNet의 작업에서 영감을 얻었으며 핵심 디자인 개념을 유지하지만 기능 추출을 위해 강력한 백본(E-ELAN)을 활용(YOLOP는 CSPdarknet를 백본으로)

- 또한 기존 작업과 달리 동일한 분기에서 주행 가능 영역 분할 및 차선 감지 작업을 실행하는 대신 디코더 헤드의 3개 분기를 활용하여 특정 작업을 수행.

- 공유된 하나의 encoder와 3개의 decoder head를 사용

해드

- YOLOv7과 유사하게 앵커 기반 다중 스케일 디택션 전략 차용

- Path Aggregation Network (PAN) 버텀업 구조와 FPN을 합쳤다.

- 디택션: 다중 스케일 기능 맵의 각 그리드에는 서로 다른 종횡비의 3개 앵커가 할당되며 디택션 헤드는 위치 오프셋과 크기 조정된 높이 및 너비는 물론 각 클래스 예측에 대한 확률 및 해당 신뢰도를 예측.

- 주행 가능 영역 : 두 작업 기능이 마지막 레이어에 있는 YOLOP와는 달리, 더 깊은 네트워크 계층이 꼭 필요하지 않다고 판단(?). FPN 전 레이어를 사용한다.

- 차선 탐지: FPN 마지막 브랜치에 연결. 차선 검출 단계에서는 Deconvolution을 적용하여 성능 더욱 향상 시켰다.

주행 영역 탐지, 라인 탐지

- 두 작업의 기능이 Neck의 마지막 레이어에 있는 YOLOP과 달리 우리는 서로 다른 의미 수준의 기능을 사용하였다. 우리는 더 깊은 네트워크 계층에서 추출된 특징이 다른 두 작업과 비교하여 운전 가능한 영역 분할에 필요하지 않다는 것을 발견하였다.

로스

- L_Box는 예측 결과와 GT 간의 중첩율, 종횡비 및 Scale 유사성을 비교

- 주행 영역 구분: 크로스 엔트로피 로스 사용, 차선 분할: Focal Loss 사용

: C는 전체 카테고리 수, 2로 설정

학습 상세

- “Cosine Annealing” policy is used to adjust the learning rate

- learning rate 0.01 and warm-restart is performed and set in the first 3 epochs.

- the momentum 0.937 weight decay 0.005

- epoch number is 300

- resize images in BDD100k dataset from 1280×720×3 --> 640×640×3 in the traing stage

1280×720×3 --> 640×384×3 in the testing stage.

- 차선 탐지에서는 Lane Mask를 8 픽셀 너비로 하려 학습하였고, 테스트 시에는 2 픽셀 너비로 유지하였다(?)

BDD 100K 데이터 셋

- 10만개 프레임 보유

- 10개의 비전 테스크 존재

| YOLOP | HybridNet | YOLOP2 | |

| 백본 | CSPdarknet | E-ELAN | |

| 인코더 | 1개 | 1개 | |

| 디코더 | 3개 | 3개 | |

| 특징 융합 방법 (Feature Fuse) |

SPP & FPN (Spatial Pyramid Pooling & Feature Pyramid Network) |

SPP & FPN | |

| 파라미터 수/ PFS | 7.9M / 49 | 12.8M / 28 | 38.9M / 91 |

| 기타 | 데이터 증강을 위한 Mosaic, Mixup 적용 |

||

| 성능 | 0.83 MAP 디택션 0.93 MIOU 주행 가능 영역 87.3 차선 탐지 91 FPS on NVIDIA TESLA V100 |

'논문 리뷰(Paper Review)' 카테고리의 다른 글

| StyleTrasfer 복습 (0) | 2024.02.13 |

|---|---|

| Meta Pseudo Labels(CVPR 2021) (0) | 2024.01.02 |

| BEVFusion: Multi-Task Multi-Sensor Fusionwith Unified Bird’s-Eye View Representation, IRCA2023 (0) | 2023.09.24 |

| Voxel Transformer, ICCV2021 (0) | 2023.09.06 |

| LaserMix for Semi-Supervised LiDAR Semantic Segmentation (0) | 2023.08.31 |